Utilisation de l’intelligence artificielle (IA) dans la Gestion des Ressouces Humaines : l’humain doit rester le seul pilote

Sortir du brouillard technique : c’est quoi, au juste, l’IA ?

Pour beaucoup, l’IA reste un concept flou. Pour faire simple, c’est la capacité d’une machine à reproduire des comportements humains comme le raisonnement ou la créativité. Elle « apprend » en analysant des montagnes de données pour en extraire des modèles statistiques et formuler des prédictions.

Il y a l’IA « classique » que nous utilisons déjà pour trier des données, et l’IA générative (comme ChatGPT ou Mistral) qui crée du texte ou des images à partir d’une simple consigne. Dans les métiers RH, on nous promet qu’elle rédigera nos fiches de poste ou analysera nos comptes-rendus à notre place.

Le mirage des gains de temps et la réalité du terrain

L’administration centrale (DGAFP) affiche une ambition séduisante : libérer jusqu’à un tiers du temps de travail des agents administratifs pour les recentrer sur des missions « à haute valeur ajoutée ».

Mais entre les discours officiels et la réalité, il y a un gouffre. En effet, 65 % des agents ne sont même pas informés des projets d’IA dans leur propre service. Plus grave encore, la fiabilité est loin d’être au rendez-vous. L’outil national « Albert », testé dans le réseau France Services, n’aurait affiché que 10 % de réponses exactes. On est loin du miracle technologique !

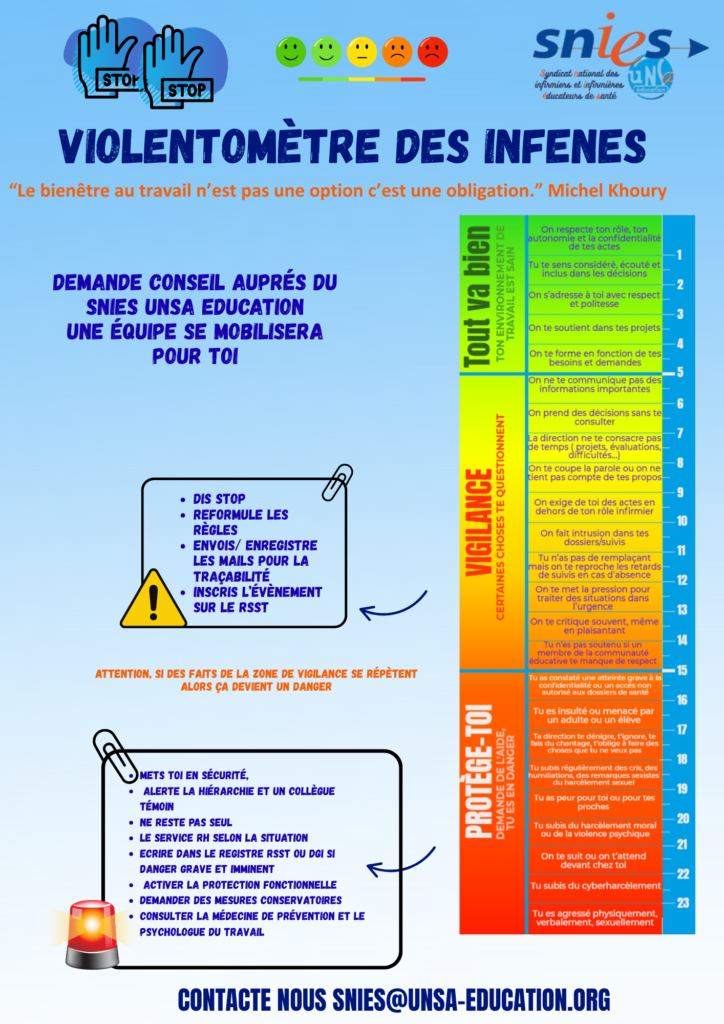

Les zones de danger : de la déshumanisation aux discriminations

L’intégration de l’IA, si elle est mal maîtrisée, comporte des risques que nous ne pouvons ignorer.

L’UNSA Éducation dénonce :

-

La « logique comptable » : C’est notre crainte principale. Nous refusons que l’IA devienne le prétexte à une réduction massive d’effectifs sous couvert de modernisation.

-

Le spectre de la discrimination : il est avéré que l’IA peut reproduire, voire amplifier, des biais sexistes ou sociaux présents dans les données d’entraînement. Si l’algorithme est conçu selon un profil type, il pénalisera systématiquement les autres.

-

Les « hallucinations » : Une IA peut inventer des faits ou produire des informations juridiquement fausses, ce qui est inacceptable pour des dossiers administratifs.

-

La perte de sens : 70 % des agents craignent une réduction des effectifs et 43 % redoutent une déshumanisation de leur métier. L’IA ne remplacera jamais l’empathie et le jugement humain nécessaires pour gérer des situations RH sensibles.

Le cadre légal : le « verrou » de l’IA Act

L’Europe a heureusement posé des barrières avec le Règlement IA Act (2024/1689). Son Article 8 est est très important car il classe les systèmes utilisés dans l’emploi et l’éducation comme « à haut risque ». Cela impose donc des obligations strictes de transparence et de qualité des données. Surtout, cela sanctuarise la supervision humaine : aucune décision RH ne doit être prise de manière autonome par une machine.

Ce que porte l’UNSA Éducation dans le dialogue social

Lors de nos interventions en instances, nous avons été clairs : nous ne validerons aucun cadre d’usage sans garanties concrètes.

Nos revendications sont fermes :

-

Pas de suppression de poste : L’IA doit servir à mieux accompagner les collègues et à améliorer le service public, pas à supprimer des emplois.

-

Une formation d’excellence : Nous refusons le simple « tuto » en ligne. Nous exigeons des formations de haut niveau, co-construites avec des experts et des chercheurs, et intégrées aux plans académiques (et nationaux) de formation (PAF – PNF).

-

Transparence : 85 % des agents regrettent l’absence de concertation. Nous exigeons d’être associés à chaque étape : du cadrage à l’évaluation, en passant par l’expérimentation.

-

Fiabilisation des données : Avant de lancer une IA, l’employeur public doit d’abord « nettoyer » et fiabiliser les données RH existantes.

-

Pas d’injonction : L’agent doit rester libre d’utiliser ou non l’outil sans subir de pression hiérarchique.

-

Négociation collective : l’ouverture indispensable d’une négociation en vue d’un accord-cadre garantissant une IA souveraine, éthique et au service des agents, excluant toute logique de dégradation des conditions de travail.

L’UNSA Éducation dit oui à une IA qui fiabilise les procédures, libère du temps pour les agents et améliore le service rendu. Mais nous dirons toujours non à une IA qui potentiellement discrimine, qui vide nos services publics de leur âme humaine ou qui menace le cœur battant de nos métiers. Le progrès technologique, c’est bien, mais sans protection réelle des emplois, des droits et de la dignité de chacun, ce n’est qu’un mirage dangereux.

Pour l’UNSA Éducation, l’humain doit rester au cœur de nos métiers.

Analyses et décryptages

Analyses et décryptages